Pokój nastolatka z 1988 roku: jak wyglądała „domowa informatyka”

Pierwsze uruchomienie: pisk głośnika i migający kursor

Na biurku stoi szara skrzynka, obok ciężki monitor z wypukłym ekranem. Ojciec naciska włącznik, wentylator w zasilaczu rusza z wyraźnym szumem, słychać pojedynczy pisk głośnika systemowego, a po chwili pojawia się czarny ekran z białymi literami. Kilka linijek tekstu, test pamięci, komunikat BIOS‑u – i nagle tylko migający kursor oraz napis C:>. Tak wyglądały narodziny domowej informatyki opartej na MS‑DOS dla tysięcy rodzin.

Dla nastolatka z końca lat 80. komputer był często pierwszym „prawdziwym” urządzeniem elektronicznym, którym mógł sterować samodzielnie. Nie było internetu, nie było smartfonów, a telewizja miała kilka kanałów. Komputer PC z MS‑DOS wydawał się więc maszyną z innego świata – potrafił liczyć, pisać, rysować i uruchamiać gry, ale wymagał nauczenia się kilku magicznych komend. Do tego dochodził dźwięk stacji dyskietek 5,25″, charakterystyczne terkotanie dysku twardego i poczucie, że każda pomyłka może „zepsuć cały system”.

Sam ekran startowy DOS‑a był surowy. Brak ikonek, brak myszki. Wszystko zaczynało się od prostego, migającego kursora. To wymuszało inne podejście psychiczne: użytkownik musiał powiedzieć komputerowi, co ma zrobić, za pomocą komendy tekstowej. Nawet uruchomienie gry wymagało wiedzy, jak przejść do odpowiedniego katalogu i jak nazywa się plik wykonywalny. Ten minimalizm paradoksalnie dawał poczucie pełnej kontroli – każdy wpisany znak miał znaczenie.

Codzienne zastosowania: od gier do pierwszych dokumentów

W przeciętnym domu PC z MS‑DOS służył do kilku podstawowych zadań. Najbardziej oczywiste były gry DOS‑owe. Klasyczne tytuły, uruchamiane z dyskietek lub z dysku twardego, wymagały wpisania nazwy pliku, na przykład:

C:GAMESPRINCE>PRINCE.EXE

Dla dzieci komputer był więc głównie konsolą, ale taką, którą trzeba było obsłużyć „od kuchni”. Oprócz gier pojawiały się proste edytory tekstu, jak WordStar, później WordPerfect czy polskie programy działające w trybie tekstowym. Uczniowie pisali w nich wypracowania, a bardziej ambitni rodzice próbowali układać faktury czy proste bazy danych w dBase.

Dużą rolę odgrywały programy edukacyjne: słowniki, encyklopedie na kilku dyskietkach, programy do nauki języków z prostą grafiką CGA lub EGA. Do tego dochodził BASIC w postaci GWBASIC lub QBasic – dla wielu to było pierwsze spotkanie z programowaniem. Pisano krótkie programy typu kalkulator, proste gry tekstowe czy animacje z użyciem komendy PRINT i grafiki tekstowej.

Na poziomie praktyki domowej kluczowe było opanowanie takich zadań jak:

- przekopiowanie gry z dyskietki na dysk twardy,

- zrobienie kopii zapasowej ważnego dokumentu,

- uruchomienie programu z nowo kupionej dyskietki,

- rozpakowanie archiwum

.ZIPlub.ARJz nowym oprogramowaniem.

Te podstawowe czynności kształtowały oswojenie z wierszem poleceń i pojęciami katalogów, plików oraz dysków. Przy okazji w głowie użytkownika budował się zarys tego, że za prostymi komendami stoi bardziej złożona warstwa sprzętowo‑programowa.

Czego użytkownik nie widział: BIOS, sterowniki i rozszerzenia

Z perspektywy zwykłego użytkownika „system” zaczynał się od momentu, gdy na ekranie pojawiał się napis MS‑DOS i znak zachęty. Cała reszta – BIOS, kontrolery, przerwania, sterowniki urządzeń – działała w tle. Ekran testu pamięci, informacja o typie procesora i wykrytych dyskach były traktowane jako niezbędne, ale nie do końca zrozumiałe preludium do właściwego korzystania z komputera.

W praktyce jednak BIOS i pliki startowe CONFIG.SYS oraz AUTOEXEC.BAT decydowały, jak komputer będzie się zachowywał. Od tego, jakie sterowniki zostały załadowane (mysz, napędy CD‑ROM, obsługa sieci), zależało, czy dany program w ogóle się uruchomi. Wiele osób nie zdawało sobie sprawy, że ich komputer mógłby być szybszy lub bardziej elastyczny, gdyby lepiej skonfigurować pamięć czy wyłączyć zbędne sterowniki.

Rozszerzenia sprzętowe – dodatkowa karta graficzna, karta dźwiękowa, dodatkowy port szeregowy – też często „po prostu działały”, ponieważ producent dostarczał gotowe sterowniki i instrukcje. Dopiero w sytuacji konfliktu przerwań (IRQ) lub adresów DMA użytkownik był zmuszony zajrzeć głębiej i poznać realia architektury IBM PC.

Wnioski z pokoju nastolatka

Domowa informatyka końca lat 80. i początku 90. w świecie PC nie zaczynała się od kolorowych okienek Windows, lecz od surowego wiersza poleceń MS‑DOS. Użytkownicy nauczyli się, że komputer to nie tylko ekran z grafiką, ale przede wszystkim zestaw poleceń, struktura katalogów i obudowany tym wszystkim system operacyjny. Ten kontakt z „nagą” maszyną ukształtował sposób myślenia całego pokolenia o tym, czym jest komputer i co znaczy nad nim panować.

Od sal komputerowych do biurka w domu: tło historyczne

Mainframe’y, minikomputery i narodziny mikrokomputera

Zanim na biurkach pojawiły się IBM PC z MS‑DOS, komputery istniały już od dekad – ale w zupełnie innym środowisku. Pierwsze mainframe’y z lat 50. i 60. zajmowały całe sale, wymagały klimatyzacji i specjalnych ekip obsługi. Użytkownik nie dotykał maszyny bezpośrednio – komunikował się z nią przez karty perforowane czy terminale znakowe, a moc obliczeniowa była dzielona między wielu klientów.

W latach 60. i 70. pojawiły się minikomputery, tańsze i mniejsze, ale wciąż przeznaczone dla instytucji, uniwersytetów i firm. Przykłady to maszyny DEC PDP‑8 czy PDP‑11. Mimo mniejszych rozmiarów logika korzystania pozostawała podobna: wielu użytkowników, centralne zasoby, wyszkolona administracja IT.

Prawdziwą zmianę przyniósł rozwój mikroprocesorów, które pozwoliły zmieścić całą jednostkę centralną komputera w jednym układzie scalonym. To otworzyło drogę do mikrokomputerów – maszyn relatywnie tanich, które mogły stać się własnością pojedynczych osób, a nie tylko organizacji. Pierwsze konstrukcje, takie jak Altair 8800, stanowiły przełom przede wszystkim psychologiczny: po raz pierwszy realne stało się, że komputer może trafić do domu hobbysty.

Altair, Apple II, Commodore, ZX Spectrum – inna filozofia niż IBM PC

Altair 8800 z 1975 roku był komputerem „dla majsterkowiczów”. Składało się go z zestawu części, programowało za pomocą przełączników na panelu przednim i wymagał ogromnej cierpliwości. Mimo to wywołał eksplozję zainteresowania mikrokomputerami. W ślad za nim pojawiły się bardziej przystępne maszyny, takie jak Apple II, Commodore PET, później Commodore 64 czy ZX Spectrum.

Te komputery domowe lat 70. i wczesnych 80. różniły się filozofią od późniejszego IBM PC. Wiele z nich miało wbudowany BASIC w ROM‑ie, dzięki czemu po włączeniu komputera użytkownik od razu trafiał do środowiska programowania. System operacyjny był często prosty lub mocno związany z konkretnym sprzętem. Dostępne były kolorowe gry, grafika i dźwięk, ale architektura tych maszyn była zamknięta i mało standardowa.

Apple II czy Commodore 64 stanowiły bardziej komputery jednofunkcyjne – każde z nich było swoim własnym światem, z własnymi standardami zapisu danych, własnymi rozszerzeniami i oprogramowaniem. IBM PC miał być inny: miał wpasować się zarówno w świat biurowy, jak i hobbystyczny, z naciskiem na otwartość i modułowość, choć początkowo nikt nie przewidywał aż takiej skali sukcesu.

„Personal computer” jako przeciwieństwo dużych systemów

Określenie personal computer (PC) miało bardzo konkretne znaczenie. Chodziło o komputer będący w posiadaniu jednej osoby, skonfigurowany pod jej potrzeby i dostępny o każdej porze. W odróżnieniu od mainframe’ów i minikomputerów, gdzie czas obliczeniowy był współdzielony, komputer osobisty dawał poczucie prywatności i kontroli.

To oznaczało zmianę roli użytkownika: nie był już petentem proszącym o zasoby centralnego systemu, lecz właścicielem własnej maszyny. Można było na niej zainstalować dowolny program, eksperymentować, kasować pliki, przeinstalować system – bez konieczności pytania administratora. Ta autonomia wpisywała się w szerszy trend indywidualizacji technologii, podobny do rozwoju magnetofonów kasetowych czy później walkmanów.

IBM PC z MS‑DOS idealnie wpasował się w tę filozofię. System operacyjny był prosty, nie narzucał zbyt wielu ograniczeń, a otwarta architektura sprzętowa pozwalała dopasować komputer do własnych potrzeb – zarówno w biurze, jak i w domu. W efekcie „personal computer” stał się nie tylko kategorią techniczną, ale też kulturową: symbolem upodmiotowienia użytkownika wobec technologii.

Warunki ekonomiczne i społeczne przełomu lat 70. i 80.

Na popularyzację komputerów osobistych złożyło się kilka równoległych zjawisk. Z jednej strony koszt elektroniki – w tym pamięci RAM i mikroprocesorów – systematycznie spadał. Z drugiej, w krajach rozwiniętych rosło znaczenie branż informacyjnych, gdzie praca z danymi, tekstem i obliczeniami stawała się coraz ważniejsza.

Firmy zaczęły dostrzegać, że inwestycja w komputery może zwiększyć produktywność pracowników biurowych. Z kolei w domach klasy średniej pojawiały się środki na zakup „inteligentnych” urządzeń – wcześniej był to kolorowy telewizor, magnetowid czy hi‑fi, a teraz coraz częściej komputer. Dopiero w takim kontekście IBM PC i MS‑DOS mogły odnieść sukces: rynek był gotowy, a świadomość potrzeby pracy z informacją rosła.

Mini‑wniosek z tej historii jest prosty: MS‑DOS i IBM PC nie powstały w próżni. Były odpowiedzią na istniejące już zjawiska: rynek mikrokomputerów hobbystycznych, spadające ceny elektroniki i rosnące zapotrzebowanie na narzędzia biurowe. To połączenie zadecydowało o ich wpływie na domową informatykę.

Narodziny IBM PC: projekt, który wymknął się z laboratorium

Decyzja IBM: szybki ruch w nietypowym dla korporacji stylu

IBM w końcu lat 70. był gigantem komputerowym skoncentrowanym na dużych systemach korporacyjnych. Rynek mikrokomputerów wydawał się z początku mało poważny. Jednak sukces Apple II oraz innych domowych komputerów zaczął przyciągać uwagę korporacji. IBM zrozumiał, że jeśli nie wejdzie na rynek personal computerów, ich klienci zaczną korzystać z rozwiązań konkurencji także w pracy.

Problemem była typowa dla IBM biurokracja i długie cykle projektowe. Aby zdążyć przed konkurencją, powołano specjalny, niewielki zespół w Boca Raton na Florydzie. Dano mu zadanie stworzenia komputera osobistego w rekordowo krótkim czasie, omijając część korporacyjnych procedur. W efekcie powstał projekt prowadzący do premiery IBM PC 5150 w 1981 roku.

Tempo prac wymusiło pragmatyczne decyzje: zamiast projektować wszystkie układy samodzielnie, sięgnięto po komponenty „z półki” – m.in. procesor Intela i gotowe układy peryferyjne. Zrezygnowano też z w pełni proprietarnego systemu operacyjnego, szukając zewnętrznego dostawcy. Ta decyzja otworzyła drogę Microsoftowi i MS‑DOS do centrum sceny.

Zespół w Boca Raton – mały startup w wielkiej korporacji

Jednym z kluczowych czynników sukcesu IBM PC był charakter zespołu projektowego. Zamiast klasycznej wielkiej grupy inżynierów rozproszonych po działach, powstała quasi‑startupowa ekipa, która działała niemal jak niezależna firma. Ich celem był produkt, nie tylko elegancja technologiczna.

Zespół miał dużą swobodę w wyborze komponentów i podejściu do architektury. Liczyło się spełnienie kilku głównych założeń: komputer miał być stosunkowo tani, elastyczny, możliwy do rozbudowy i dostatecznie wydajny do zastosowań biurowych. Uznano, że standardem dla oprogramowania będą systemy zbliżone do CP/M, co później ułatwiło akceptację MS‑DOS.

Taki sposób pracy – mały, zwinny zespół wewnątrz dużej korporacji – stał się wzorem, który później naśladowały inne firmy technologiczne. Paradoks polega na tym, że struktura organizacyjna IBM, stworzona po to, by ochronić projekt przed biurokracją, jednocześnie umożliwiła powstanie systemu, który w dalszej perspektywie osłabił monopol firmy na rynku komputerów.

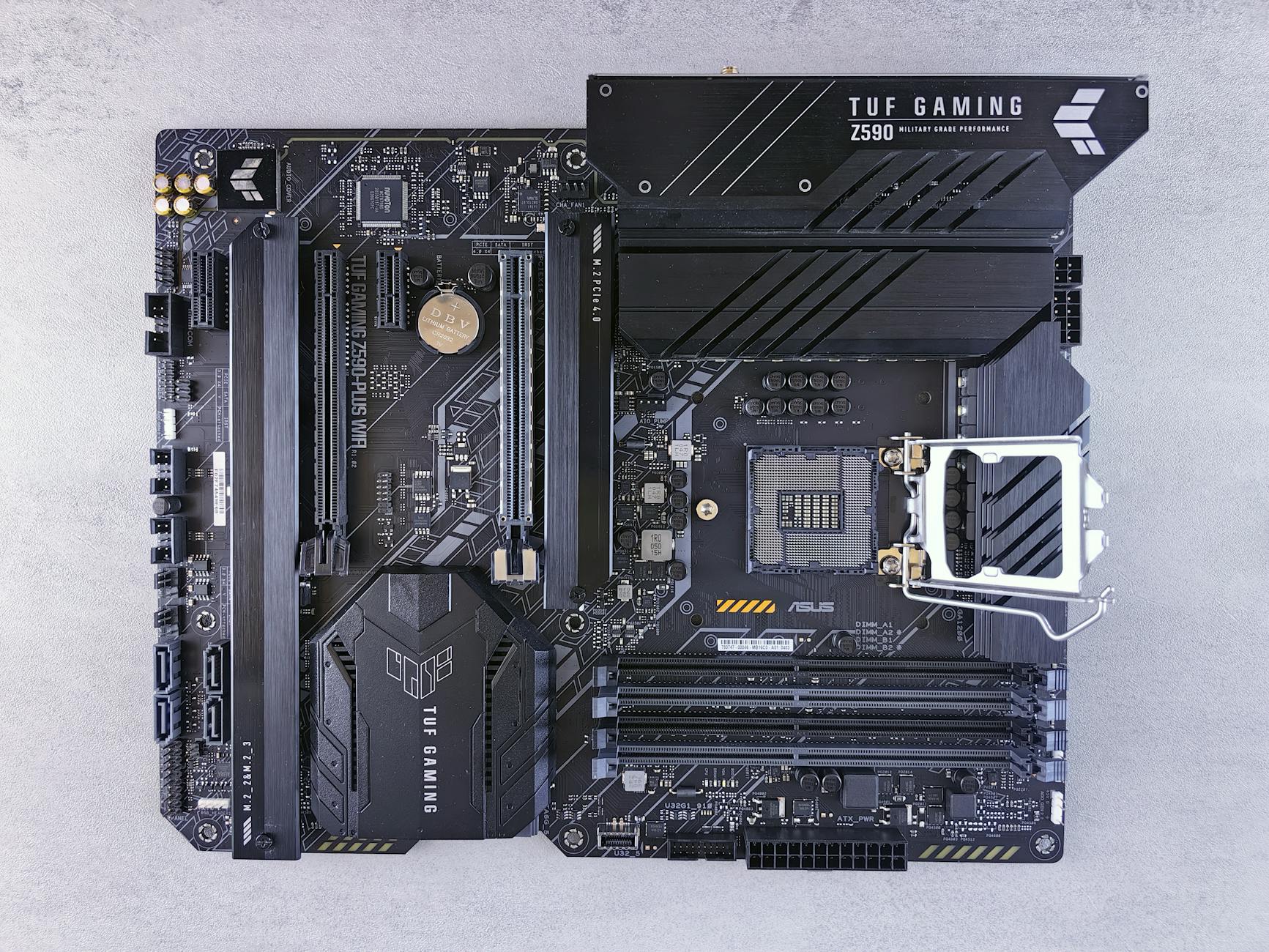

Architektura IBM PC: Intel 8088, sloty i kompromisy

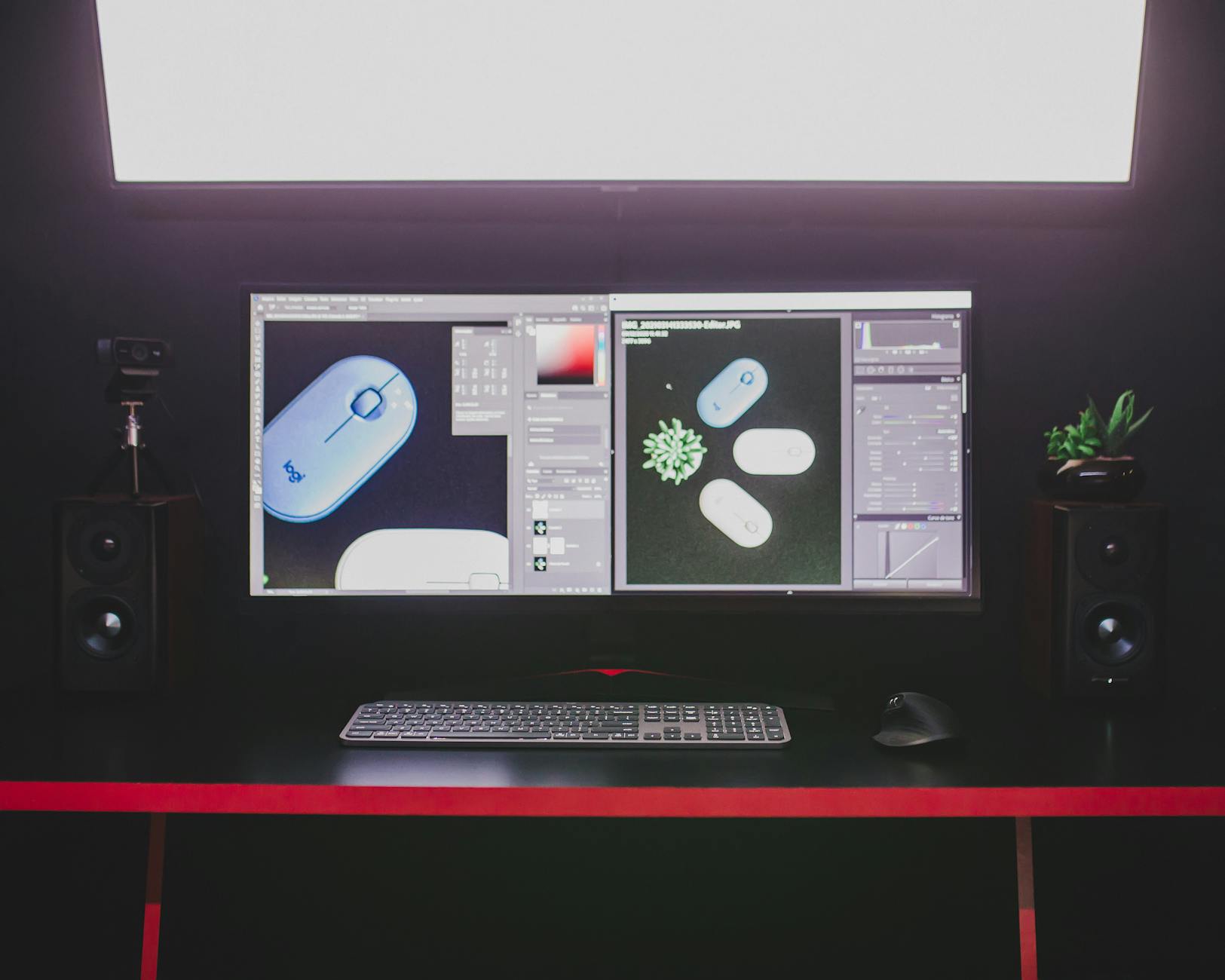

Co naprawdę siedziało w środku „peceta” z MS‑DOS

Wyobraź sobie serwisanta, który w 1986 roku przyjeżdża do mieszkania w bloku. Otwiera obudowę PC‑ta śrubokrętem krzyżakowym, wyciąga jedną kartę, wkłada inną, domyka skrzynkę i po chwili na monitorze znowu pojawia się migający kursor C:>. Tak wyglądała codzienność – komputer był zestawem klocków, a nie zamkniętym „magicznie” urządzeniem.

Wewnątrz typowego IBM PC lub kompatybilnej maszyny znajdowała się płyta główna z procesorem Intel 8088 lub później 8086/80286, kilka gniazd rozszerzeń (ISA), kości pamięci RAM w postaci DIP‑ów oraz układy odpowiedzialne za obsługę magistrali, przerwań i DMA. To, co dziś jest jednym scalakiem w laptopie, wtedy stanowiło gąszcz pojedynczych chipów i przewodów. Użytkownik widział jednak tylko trzy główne elementy: obudowę (często typu desktop), monitor oraz klawiaturę z charakterystycznym, głośnym „klikaniem”.

Kluczową cechą projektu IBM PC była modułowość. Obudowę otwierało się kilkoma śrubami, a w środku czekały sloty na karty: graficzną, kontroler dysków, porty szeregowe/równoległe, ewentualnie kartę dźwiękową czy sieciową. Samo istnienie tych slotów sprzyjało powstaniu ogromnego rynku dodatków: od prostych kart I/O, po zaawansowane kontrolery SCSI. MS‑DOS pełnił tu rolę cienkiej warstwy, która miała dogadać się z BIOS‑em i resztą sprzętu na tyle dobrze, by programy mogły działać bez znajomości wszystkich szczegółów elektroniki.

Mikro‑wniosek: „PC z MS‑DOS” to nie był jednolity produkt, tylko platforma. Jeden użytkownik miał tylko stację dyskietek i czarno‑biały monitor, inny – twardy dysk, kartę Hercules i drukarkę igłową. MS‑DOS spinał te różne konfiguracje wspólnym interfejsem: katalogami, plikami, literami dysków i prostymi poleceniami.

Architektura IBM PC w praktyce: BIOS, magistrala i kompromis 8088

W małej firmie księgowej pod koniec 80. lat czasem wystarczał jeden komputer w sekretariacie. Gdy trzeba było dopisać kolejną drukarkę lub terminal, informatyk wyjmował obudowę spod biurka, dokładał kartę i wszystko „magicznie” działało – byle BIOS ją rozpoznał, a system dostał sterownik.

Procesor Intel 8088, użyty w pierwszym IBM PC, był kompromisem. Wewnętrznie 16‑bitowy, na zewnątrz miał 8‑bitową magistralę danych, co umożliwiało użycie tańszych układów peryferyjnych i uprościło projekt płyty głównej. Dzięki temu IBM mógł szybciej wprowadzić maszynę na rynek, kosztem części wydajności. Dopiero późniejsze konstrukcje sięgnęły po pełne 16‑bitowe magistrale (8086, 80286, a potem 32‑bitowe 80386).

Serce startu komputera stanowił BIOS (Basic Input/Output System), zapisany w pamięci ROM. Po włączeniu zasilania BIOS wykonywał procedurę POST, wykrywał podstawowy sprzęt, a następnie próbował odczytać pierwszy sektor z dyskietki lub dysku – tzw. boot sector. W nim znajdował się niewielki kod ładujący właściwy system operacyjny: w przypadku MS‑DOS – pliki IO.SYS (lub IBMBIO.COM), MSDOS.SYS (IBMDOS.COM) i COMMAND.COM.

Taki podział odpowiedzialności miał praktyczne konsekwencje. Producent sprzętu mógł dostarczyć własny BIOS, dostosowany do swojej płyty głównej, zachowując kompatybilność na poziomie przerwań i podstawowych funkcji. Microsoft z kolei skupiał się na warstwie systemu plików, zarządzania plikami i prostym interfejsie tekstowym. Standaryzacja interfejsów BIOS‑DOS stała się fundamentem dla eksplozji klonów PC – bo wystarczyło zachować zgodność z istniejącym zestawem funkcji, aby większość programów „po prostu działała”.

Z perspektywy producentów konkurencyjnych maszyn była to broń obosieczna. Z jednej strony łatwo było „wejść” na rynek pecetów, tworząc kompatybilną płytę główną i BIOS. Z drugiej – trudniej było się wyróżnić, bo każdy większy odchył od standardu groził niekompatybilnością. MS‑DOS po cichu wymuszał ujednolicenie sprzętu, nawet jeśli producenci chcieli eksperymentować.

Pierwsze spotkanie z MS‑DOS: czarny ekran, biały kursor

Nastolatek, który po raz pierwszy włączał w domu klona PC z końcówki lat 80., widział zwykle prosty komunikat: nazwa systemu, numer wersji, ścieżka do katalogu głównego i migający kursor przy C:>. Żadnego pulpitu, ikon, myszki. Trzeba było wpisać pierwsze polecenie – choćby DIR – żeby komputer „odpowiedział”.

MS‑DOS był systemem jednozadaniowym. Standardowo uruchamiał jeden program na raz, a po jego zamknięciu wracał do interpretera poleceń COMMAND.COM. Użytkownik żył w świecie katalogów (folderów) i plików, adresowanych literami dysków: A: oznaczało najczęściej stację dyskietek, C: – dysk twardy. Zamiast klikania w ikony wpisywało się komendy: COPY, DEL, TYPE, FORMAT, CHKDSK. Ten minimalizm dawał poczucie kontroli – każda operacja była świadomą decyzją użytkownika.

Do pracy z programami służyły proste pliki wsadowe .BAT, które pozwalały automatyzować sekwencje poleceń. W wielu firmach funkcjonowały małe „menedżery” pisane przez lokalnych specjalistów: po włączeniu komputera startował menu‑program w BAT lub w języku Clipper/FoxPro, z którego wybierało się opcje klawiszami 1, 2, 3. Dla pracownika księgowości system „zniknął” – widział tylko listę: Faktury, Magazyn, Księga główna.

Krótki wniosek: MS‑DOS wymagał od domowego użytkownika minimum „alfabetyzmu technicznego”. Trzeba było znać nazwy plików, strukturę katalogów i podstawowe polecenia. W zamian otrzymywało się środowisko przewidywalne i zaskakująco elastyczne, jeśli ktoś miał odwagę wejść głębiej.

Skąd wziął się MS‑DOS: od QDOS do standardu branżowego

Gdy CP/M nie spotkał się z IBM: luka, którą ktoś musiał wypełnić

W małej firmie programistycznej na przełomie lat 70. i 80. wielu twórców oprogramowania pisało aplikacje dla systemu CP/M. To tam sprzedawały się edytory tekstu, arkusze kalkulacyjne i narzędzia programistyczne. Nic dziwnego, że gdy IBM szukał systemu dla swojego PC, naturalnym kandydatem był właśnie CP/M i firma Digital Research.

Historia rozmów IBM z Digital Research obrosła legendą. Faktem jest, że z różnych powodów – biznesowych i prawnych – nie doszło do szybkiego porozumienia. IBM potrzebował gotowego lub prawie gotowego systemu na procesor 8088, zgodnego w miarę możliwości z CP/M, aby programiści mogli łatwo przenosić aplikacje. Każdy miesiąc opóźnienia groził utratą przewagi nad konkurentami.

Microsoft był wtedy znany przede wszystkim z interpretera BASIC, nie z systemów operacyjnych. Mimo to Bill Gates i jego zespół zrozumieli, że system dla IBM PC to wejście do zupełnie nowej ligi. Gdy IBM zapytał, czy Microsoft może dostarczyć OS, odpowiedź brzmiała: „tak” – nawet jeśli w tamtym momencie gotowego produktu jeszcze nie było.

86‑DOS/QDOS: „Quick and Dirty” fundament imperium

W tym samym czasie firma Seattle Computer Products opracowała własny system operacyjny dla procesora 8086 – początkowo nazwany QDOS (Quick and Dirty Operating System), później 86‑DOS. Był to w zasadzie klon CP/M, dostosowany do architektury 16‑bitowej, z podobnymi poleceniami i API, ale z kilkoma istotnymi różnicami strukturalnymi.

Microsoft dostrzegł w 86‑DOS gotową bazę. Najpierw uzyskał licencję na jego wykorzystanie, a następnie kupił prawa autorskie do systemu. Na tej podstawie rozpoczęto prace nad dostosowaniem go do wymagań IBM: zmiana interfejsów, integracja z BIOS‑em PC, dopracowanie narzędzi dyskowych i plików startowych.

Dla użytkownika końcowego istotne było to, że MS‑DOS wyglądał znajomo dla osób znających CP/M. Polecenia typu DIR, REN, ERA/DEL były podobne lub identyczne, co ułatwiało przejście programistom i operatorom. Jednocześnie nowy system mógł rozwinąć własną tożsamość – m.in. w sposobie obsługi dysków, plików wykonywalnych .COM i .EXE oraz w integracji z BIOS‑em IBM.

Mikro‑wniosek z tej części historii brzmi: MS‑DOS nie powstał z niczego. Był świadomym wykorzystaniem istniejącego dorobku (CP/M, 86‑DOS) i szybkim dopasowaniem go do projektu, który obiecywał ogromny rynek. „Quick and Dirty” przerodziło się w fundament, na którym wielu ludzi budowało domową informatykę przez ponad dekadę.

Umowa z IBM: gdy „PC‑DOS” i „MS‑DOS” stały się bliźniakami

W korporacyjnej sali konferencyjnej IBM na początku lat 80. negocjowano detale, które później zaważyły na losach całej branży. Jednym z kluczowych elementów była decyzja, że IBM będzie dostarczał własną wersję systemu pod nazwą PC‑DOS, podczas gdy Microsoft zachowa prawo do licencjonowania niemal identycznego systemu innym producentom – jako MS‑DOS.

Technicznie różnice między PC‑DOS a MS‑DOS przez długi czas były niewielkie: inne nazwy plików systemowych u IBM (IBMBIO.COM, IBMDOS.COM) oraz drobne modyfikacje związane z konkretnym sprzętem. Z punktu widzenia użytkownika programu WordStar czy gry Prince of Persia nie miało to większego znaczenia – ważne było, że aplikacja działała „na DOS‑ie”.

Biznesowo jednak ta subtelność otworzyła drzwi dla całej fali kompatybilnych klonów PC. Firmy takie jak Compaq, Olivetti, Amstrad czy rodzimi producenci maszyn w Europie Środkowo‑Wschodniej mogły tworzyć własny sprzęt zgodny z BIOS‑em IBM i preinstalować MS‑DOS jako system. IBM stracił monopol na „własny” standard, podczas gdy Microsoft zaczął dominować na rynku oprogramowania systemowego.

Domowe komputery z lat 80. i początku 90. często różniły się logo na obudowie, ale w środku korzystały z tego samego systemu i zestawu komend. Dla użytkownika oznaczało to coś przełomowego: mógł skopiować dyskietkę z gry lub programem od kolegi i miał dużą szansę, że zadziała także u niego – jeśli tylko miał kompatybilny PC z MS‑DOS.

Jak wyglądał MS‑DOS „od środka”: struktura, ograniczenia, filozofia

Warstwa po warstwie: BIOS, jądro DOS‑u i interpreter poleceń

Wyobraź sobie nauczyciela informatyki w szkole średniej w 1992 roku, który tłumaczy uczniom, co dzieje się od chwili naciśnięcia przycisku „Power”. Zamiast magicznego „komputer się włącza”, na tablicy pojawia się uproszczony schemat: BIOS → IO.SYS → MSDOS.SYS → COMMAND.COM.

BIOS odpowiadał za pierwszy etap: test sprzętu, obsługę przerwań sprzętowych (klawiatura, zegar, dyski, wideo) i podstawowe procedury wejścia/wyjścia. Nad nim działała warstwa systemu operacyjnego – pliki IO.SYS i MSDOS.SYS, zawierające m.in. obsługę systemu plików FAT, zarządzanie plikami, pamięcią konwencjonalną i proste mechanizmy buforowania.

Na szczycie tej układanki znajdował się interpreter poleceń, domyślnie COMMAND.COM. To on przyjmował komendy użytkownika, realizował proste polecenia wbudowane (np. DIR, CD, COPY) i uruchamiał programy .COM oraz .EXE. Co ciekawe, COMMAND.COM sam w sobie był tylko programem – teoretycznie można go było zastąpić innym interpreterem, co wykorzystywały niektóre zaawansowane narzędzia powłoki, np. 4DOS.

Taki podział na warstwy dawał elastyczność. Producenci sprzętu mogli modyfikować BIOS pod własne potrzeby, Microsoft aktualizował jądro MS‑DOS, a użytkownicy zaawansowani instalowali alternatywne interpretery poleceń i narzędzia. Pod maską panował prosty, ale konsekwentny porządek, który sprzyjał zrozumieniu działania komputera nawet przez ambitnych nastolatków.

System plików FAT i litery dysków: mapa cyfrowego domu

Nastolatek z 1990 roku siada do komputera, wkłada dyskietkę z grą i patrzy, jak po kilku sekundach ekran zapełnia się listą plików. Nie ma ikon, nie ma podglądu miniaturek – jest surowe DIR i prosty spis nazw. A jednak po kilku tygodniach taki użytkownik „widzi” w głowie strukturę całego dysku, jakby miał przed sobą plan mieszkania.

U podstaw tego porządku leżał system plików FAT (File Allocation Table). Była to po prostu tabela – spis wszystkich „kawałków” dysku (klastrów) z informacją, które z nich należą do danego pliku, a które są wolne. Z perspektywy DOS‑u dysk był ciągiem bloków danych, a FAT mówił: tutaj zaczyna się plik, tu są jego kolejne części, a w tym miejscu się kończy.

Wczesne wersje używały formatu FAT12 (głównie dla dyskietek), później pojawił się FAT16 (dla coraz większych dysków twardych). Nazwy plików trzymały się zasady 8.3: maksymalnie osiem znaków nazwy, kropka, trzy znaki rozszerzenia, np. LISTOPAD.DOC, GRA1.EXE, AUTOEXEC.BAT. To wymuszało dyscyplinę nazewniczą: zamiast „Raport roczny 1989 poprawka ostateczna” było po prostu RAP89_OST.DOC.

Każdy nośnik dostawał swoją literę dysku. Domowy użytkownik intuicyjnie wiedział: A: – stacja dyskietek, C: – dysk twardy, później D: – drugi dysk lub napęd CD‑ROM. Litery były stałym punktem odniesienia. Zamiast „zapisz na pendrive” mówiło się: „zapisz na A:” albo „skopiuj na D:”. Ta prostota utrwaliła się tak mocno, że ślady logiki DOS‑u widać do dziś w systemie Windows.

System plików FAT był prymitywny jak na późniejsze standardy: nie miał praw dostępu, nie znał dziennika zmian, był podatny na uszkodzenia przy nagłym wyłączeniu komputera. Jednocześnie łatwo go było „ogarnąć” mentalnie. Użytkownik wiedział, że każdy katalog to lista plików i podkatalogów, a narzędzie CHKDSK, a później SCANDISK, potrafiło „posprzątać” chaos po nieudanym zapisie.

Mini‑wniosek: prosta struktura FAT i litery dysków tworzyły bardzo zrozumiały model „domowego archiwum”. Nawet jeśli za kulisami działy się operacje na klastrach, użytkownik czuł, że porusza się po logicznej, przejrzystej mapie.

Pamięć konwencjonalna, górna, rozszerzona: walka o każdy kilobajt

Scenka z serwisu komputerowego w 1993 roku: klient przynosi komputer i narzeka, że nowa gra „nie chce się włączyć”. Technik wpisuje kilka poleceń, zagląda do CONFIG.SYS, coś komentuje pod nosem o „za małej pamięci konwencjonalnej”, po czym żongluje sterownikami tak, by uwolnić dodatkowe 20 KB. Gra rusza, klient wychodzi z poczuciem, że był świadkiem magii.

U podstaw tej magii leżało jedno z najbardziej limitujących założeń MS‑DOS: bariera 640 KB pamięci konwencjonalnej. Pierwsze komputery PC z procesorem 8088 miały 1 MB przestrzeni adresowej, ale tylko dolne 640 KB przeznaczono dla programów i systemu, resztę zarezerwowano dla BIOS‑u, kart rozszerzeń i pamięci wideo. Ten historyczny kompromis ciągnął się za użytkownikami przez całą erę DOS‑u.

Powyżej tej granicy zaczynała się górna pamięć (Upper Memory Area, 640–1024 KB) oraz później różne rozwiązania typu EMS (Expanded Memory Specification) i XMS (Extended Memory Specification). Były to sprytne obejścia pozwalające wykorzystać więcej RAM‑u niż „gołe” 640 KB – ale wymagały dodatkowych sterowników i odpowiedniej konfiguracji.

Codzienność wyglądała tak, że użytkownicy i administratorzy uczyli się żonglowania wpisami w plikach CONFIG.SYS i AUTOEXEC.BAT. Trzeba było zdecydować:

- jakie sterowniki załadować do górnych obszarów pamięci (

DEVICEHIGH,LOADHIGH), - czy włączyć menedżera pamięci rozszerzonej (

EMM386.EXE), - jak pogodzić potrzeby sieci, myszy, napędu CD‑ROM i gry, która domagała się „600K free conventional memory”.

Ta „gimnastyka” uczyła myślenia w kategoriach zasobów. Każdy nowy sterownik oznaczał koszt w kilobajtach, więc zaawansowani użytkownicy mieli po kilka wersji plików startowych, wybieranych z menu przy włączeniu komputera: „Konfiguracja do gier”, „Konfiguracja do pracy w sieci”, „Minimalna konfiguracja serwisowa”. MS‑DOS nie ukrywał przed nikim ograniczeń – kazał się z nimi zmierzyć.

Mini‑wniosek: praca z pamięcią w DOS‑ie była dla wielu pierwszą lekcją „inżynierii kompromisu”. Nie dało się włączyć wszystkiego naraz, więc trzeba było świadomie wybierać, co jest naprawdę potrzebne.

Sterowniki i pliki startowe: mały teatr przy uruchamianiu komputera

Rano w biurze księgowa włącza komputer i odruchowo czeka, aż na ekranie pojawi się znajome menu aplikacji. W tle przez kilka sekund migają napisy: nazwy sterowników, informacje o pamięci, komunikaty sieciowe. Dla niej to tylko „przebłysk przed pracą”. Dla administratora – scenariusz, który sam napisał.

MS‑DOS był systemem, w którym uruchamianie komputera było w dużej mierze konfigurowalne tekstowo. Dwa pliki odgrywały tu główne role: CONFIG.SYS i AUTOEXEC.BAT.

CONFIG.SYS ładował sterowniki jądra i określał ogólne parametry systemu. To tam pojawiały się wpisy typu:

DEVICE=HIMEM.SYS– obsługa pamięci rozszerzonej,DEVICE=EMM386.EXE– menedżer pamięci emulujący EMS,DEVICE=OAKCDROM.SYS /D:MSCD001– sterownik napędu CD‑ROM,FILES=40,BUFFERS=20– parametry pracy z plikami i dyskiem.

Z kolei AUTOEXEC.BAT był jak scenariusz powitalny. Ustawiał zmienne środowiskowe (PATH, TEMP), ładował rezydentne programy (KEYB, MSCDEX, sterownik myszy), a często także uruchamiał na końcu konkretną aplikację lub menu. Prostym mechanizmem CHOICE i instrukcjami warunkowymi można było zbudować menu startowe: po włączeniu komputera użytkownik wybierał tryb pracy, a dalsza część skryptu dostosowywała środowisko.

W domu wyglądało to często tak, że starszy brat przygotowywał różne warianty AUTOEXEC.BAT, aby młodsze rodzeństwo mogło wybrać „tryb gier” bez obawy, że popsuje coś w „trybie pracy”. Prosta logika warunkowa w plikach wsadowych była pierwszym kontaktem z programowaniem dla tysięcy ludzi, którzy nigdy nie sięgnęli po Pascala czy C.

Mini‑wniosek: konfigurowalne uruchamianie MS‑DOS‑u sprawiało, że komputer można było „uszyć na miarę” – czasem w skali całej firmy, czasem w skali jednego biurka w pokoju nastolatka.

Filozofia „jednego zadania”: program ma cały komputer dla siebie

Wyobraź sobie, że odpalasz grę i nagle cały świat komputera przestaje istnieć. Nie ma powiadomień, nie ma komunikatów z innych programów, nikt nie pisze z komunikatora. Jest tylko gra i ty. Tak właśnie działał MS‑DOS: w trybie jednego zadania na raz.

Kluczowe założenie DOS‑u brzmiało: brak prawdziwego wielozadaniowości preemptive. System nie odbierał programom czasu procesora, aby go podzielić „sprawiedliwie” między kilka aplikacji. Jeśli jakaś gra lub edytor tekstu przejmował kontrolę, to naprawdę miał ją niemal w całości. Ewentualne przełączanie między zadaniami wymagało dodatkowych nakładek (np. DESQview) lub wykorzystania środowisk takich jak Windows w trybie pracy nad DOS‑em.

Taki model miał dwie twarze. Z jednej strony oznaczał wysoką wydajność pojedynczej aplikacji – cała pamięć konwencjonalna, całe CPU i dostęp do sprzętu były do dyspozycji uruchomionego programu. Dlatego gry, programy graficzne czy rozbudowane aplikacje bazodanowe mogły zaskakiwać szybkością, mimo skromnych jak na dzisiejsze standardy parametrów sprzętu.

Z drugiej strony brak izolacji między procesami i bezpośredni dostęp do sprzętu utrudniały stabilność. Zawieszony program często oznaczał zawieszony komputer. Próba bezpośredniego sterowania kartą graficzną czy dźwiękową mogła zakończyć się resetem. Producentom oprogramowania zależało więc na tym, by „dobrze się zachowywać” – nie tylko dla użytkownika, ale i dla własnej reputacji.

W praktyce użytkownik miał poczucie bliskości ze sprzętem. Konfigurując parametry gry, podawał porty i przerwania: „Sound Blaster na IRQ 5, adres 220h”. Z dzisiejszej perspektywy brzmi to egzotycznie, wtedy było codziennością dla każdego, kto chciał wycisnąć maksymalne możliwości z komputera.

Mini‑wniosek: filozofia „jeden program ma wszystko” sprawiła, że PC z DOS‑em zachowywał się jak narzędzie specjalistyczne, a nie jak centrum wszystkiego naraz. Uczyła skupienia – i technicznego, i użytkowego.

Rozszerzenia, nakładki, środowiska: gdy DOS próbował dorosnąć

Na początku lat 90. wielu użytkowników czuło rosnący dysonans: ich potrzeby stawały się bardziej złożone, a DOS wciąż był czarnym ekranem z migającym kursorem. W biurze trzeba było mieć otwarty edytor tekstu, arkusz kalkulacyjny i prosty program komunikacyjny. W domu chciało się słuchać muzyki z modułu MOD i jednocześnie kopiować pliki. Ktoś musiał to pogodzić.

Rozwiązaniem nie była od razu wymiana systemu, lecz nakładki i środowiska pracujące „na” DOS‑ie. Pojawiły się menedżery plików z interfejsem ekranowym (Norton Commander, DOS Navigator), a także środowiska dające namiastkę wielozadaniowości – jak wspomniany DESQview czy różne programy typu „task switcher”, pozwalające przełączać się między aplikacjami.

Szczególne miejsce zajmowały wczesne wersje Windows: 3.0, 3.1, 3.11. Formalnie nie były jeszcze pełnoprawnym, samodzielnym systemem operacyjnym. Działały jako środowisko graficzne uruchamiane na bazie DOS‑u. Pod spodem wciąż pracował MS‑DOS z jego sterownikami, systemem plików FAT i plikami startowymi, a Windows przejmował kontrolę, by dać użytkownikowi wielookienny, myszkowy interfejs.

W domu wyglądało to często tak: najpierw było czyste C:>, potem ktoś zainstalował Norton Commandera i przesiadł się na dwupanelowy, niebieski ekran, a po roku lub dwóch pojawił się Windows 3.1. Każdy z tych etapów dokładał warstwę komfortu, ale nikt nie miał wątpliwości, że „prawdziwym” systemem pozostaje DOS. To do niego wracało się, gdy coś się psuło, gdy trzeba było „na szybko” sformatować dyskietkę lub naprawić uszkodzony plik konfiguracyjny.

Mini‑wniosek: kolejne nakładki nie tyle zastępowały MS‑DOS, co go okrywały. Podobnie jak dywan na dobrze znanej podłodze – wygodniej się chodzi, ale układ desek wciąż determinuje, jak zachowuje się cały dom.

Najczęściej zadawane pytania (FAQ)

Jak wyglądało pierwsze uruchomienie komputera PC z MS‑DOS w domu?

Nastolatek z końca lat 80. wciskał włącznik i zamiast kolorowego logo widział migający test pamięci, komunikaty BIOS‑u i wreszcie czarny ekran z napisem typu C:>. Do tego dochodził charakterystyczny pisk głośnika i szum wentylatora – całość bardziej przypominała uruchamianie poważnej maszyny niż domowej zabawki.

Po starcie system nie proponował żadnego menu, ikon ani myszki. Użytkownik od razu trafiał do wiersza poleceń i musiał sam wpisać pierwszą komendę, żeby komputer zrobił cokolwiek pożytecznego – od uruchomienia gry po odpalenie edytora tekstu.

Do czego najczęściej używano komputerów z MS‑DOS w domach?

Typowy scenariusz wyglądał tak: dzieci odpalają gry z katalogu C:GAMES, rodzice próbują pisać faktury w prostym programie, a ktoś po godzinach uczy się pisać pierwsze linijki w BASIC‑u. Komputer stał na biurku w pokoju i służył całej rodzinie, choć każdy używał go trochę inaczej.

Najpopularniejsze zastosowania to:

- gry DOS‑owe uruchamiane z dyskietek lub dysku twardego,

- edytory tekstu (WordStar, WordPerfect, polskie programy tekstowe) do wypracowań i pism,

- proste bazy danych i arkusze do domowych rozliczeń,

- programy edukacyjne: słowniki, encyklopedie, kursy językowe,

- nauka programowania w GWBASIC lub QBasic.

Te czynności uczyły przy okazji, czym są pliki, katalogi i dyski.

Czym różnił się MS‑DOS od komputerów typu Commodore 64 czy ZX Spectrum?

Dziecko z Commodore 64 po włączeniu komputera od razu widziało wbudowany BASIC i kolorowy ekran, a całość była jednym „zamkniętym światem” z własnymi standardami. W przypadku PC z MS‑DOS start odbywał się przez BIOS, pliki CONFIG.SYS, AUTOEXEC.BAT, a dopiero potem pojawiał się surowy wiersz poleceń.

Commodore czy ZX Spectrum miały architekturę mocno związaną z konkretnym modelem – gra czy program były pisane w zasadzie „pod ten jeden komputer”. IBM PC z MS‑DOS stawiał na otwartość i modułowość: można było zmieniać karty, dyski, dokładać pamięć i instalować najróżniejsze programy, które działały na całej rodzinie kompatybilnych PC.

Co musiał umieć zwykły użytkownik, żeby poradzić sobie z MS‑DOS w domu?

Scena z życia: ktoś przynosi nową grę na kilku dyskietkach, a nastolatek siada do klawiatury i bez myszki musi ją zainstalować i uruchomić. Żeby to zrobić, trzeba było znać kilka podstawowych komend i mieć w głowie ogólny porządek na dyskach.

Najważniejsze umiejętności obejmowały:

- poruszanie się po katalogach (

CD,DIR), - kopiowanie plików i robienie kopii zapasowych (

COPY,XCOPY), - uruchamianie programów po nazwie pliku wykonywalnego (

.EXE,.COM,.BAT), - obsługę dyskietek i dysków twardych (zmiana dysku, formatowanie),

- rozpakowywanie archiwów

.ZIPi.ARJspecjalnymi narzędziami.

Z czasem wiele osób zaczynało też rozumieć, że za tym stoi głębsza logika systemu plików i sprzętu.

Jaką rolę odgrywały BIOS, CONFIG.SYS i AUTOEXEC.BAT w komputerach z MS‑DOS?

Przeciętny domowy użytkownik widział tylko migające komunikaty na starcie i traktował je jak „magiczne napisy przed właściwym komputerem”. W rzeczywistości to właśnie BIOS i pliki startowe decydowały, jak maszyna będzie działać: ile pamięci zostanie dostępne, jakie sterowniki się załadują i czy gra w ogóle ruszy.

W CONFIG.SYS oraz AUTOEXEC.BAT umieszczało się m.in. sterowniki myszy, napędu CD‑ROM, obsługi sieci czy rozszerzeń pamięci. Źle skonfigurowane pliki mogły spowolnić system lub blokować niektóre programy, a dobrze ustawione – „odtykały” komputer i pozwalały uruchomić bardziej wymagające gry i aplikacje.

Dlaczego era MS‑DOS tak mocno wpłynęła na domową informatykę?

Nastolatki, które w latach 80. i 90. uczyły się wpisywać komendy w DOS‑ie, widziały komputer nie jako czarną skrzynkę, ale jako maszynę, której można coś konkretnie zlecić. Każde polecenie miało widoczny efekt, a błąd potrafił „rozsypać” cały system – to budowało szacunek do tego, co dzieje się „pod spodem”.

Ta epoka nauczyła całe pokolenie, że komputer to przede wszystkim:

- system operacyjny oparty na plikach i katalogach,

- warstwa sprzętowa, którą da się rozbudować i zrozumieć,

- narzędzie, które wymaga świadomej obsługi, a nie tylko klikania w ikony.

Późniejsze środowiska graficzne, jak Windows, były już dla nich „nakładką” na coś, co znali od środka, a nie całkowicie nową, magiczną zabawką.

Co odróżniało „personal computer” z MS‑DOS od dużych systemów mainframe i minikomputerów?

W firmie czy na uczelni użytkownik logował się na terminal, dzieląc moc obliczeniową z innymi. W domu siadał przy swoim PC i miał maszynę „na wyłączność” – dostępną o każdej porze, skonfigurowaną pod jego gry, programy i dokumenty.

Personal computer z MS‑DOS był przeciwieństwem scentralizowanego mainframe’a: zamiast jednej wielkiej maszyny z działem IT pojawiły się tysiące małych komputerów stojących w mieszkaniach i małych biurach. To przesunięcie – z sal komputerowych na biurko nastolatka – w praktyce otworzyło drogę do późniejszej powszechności komputerów i internetu.