Skąd nagły powrót mody na ARM w laptopach

ARM kontra x86 po ludzku: o co naprawdę chodzi

ARM i x86 to dwie różne „abecadła” dla procesorów. x86 to język, w którym od dekad pisano programy dla komputerów PC – od DOS‑u, przez Windows 95, po dzisiejsze laptopy z Windows 11 i większość Linuxów na PC. ARM to z kolei język, który zrobił karierę w smartfonach, tabletach i urządzeniach IoT. Oba podejścia robią to samo – wykonują instrukcje – ale robią to inaczej.

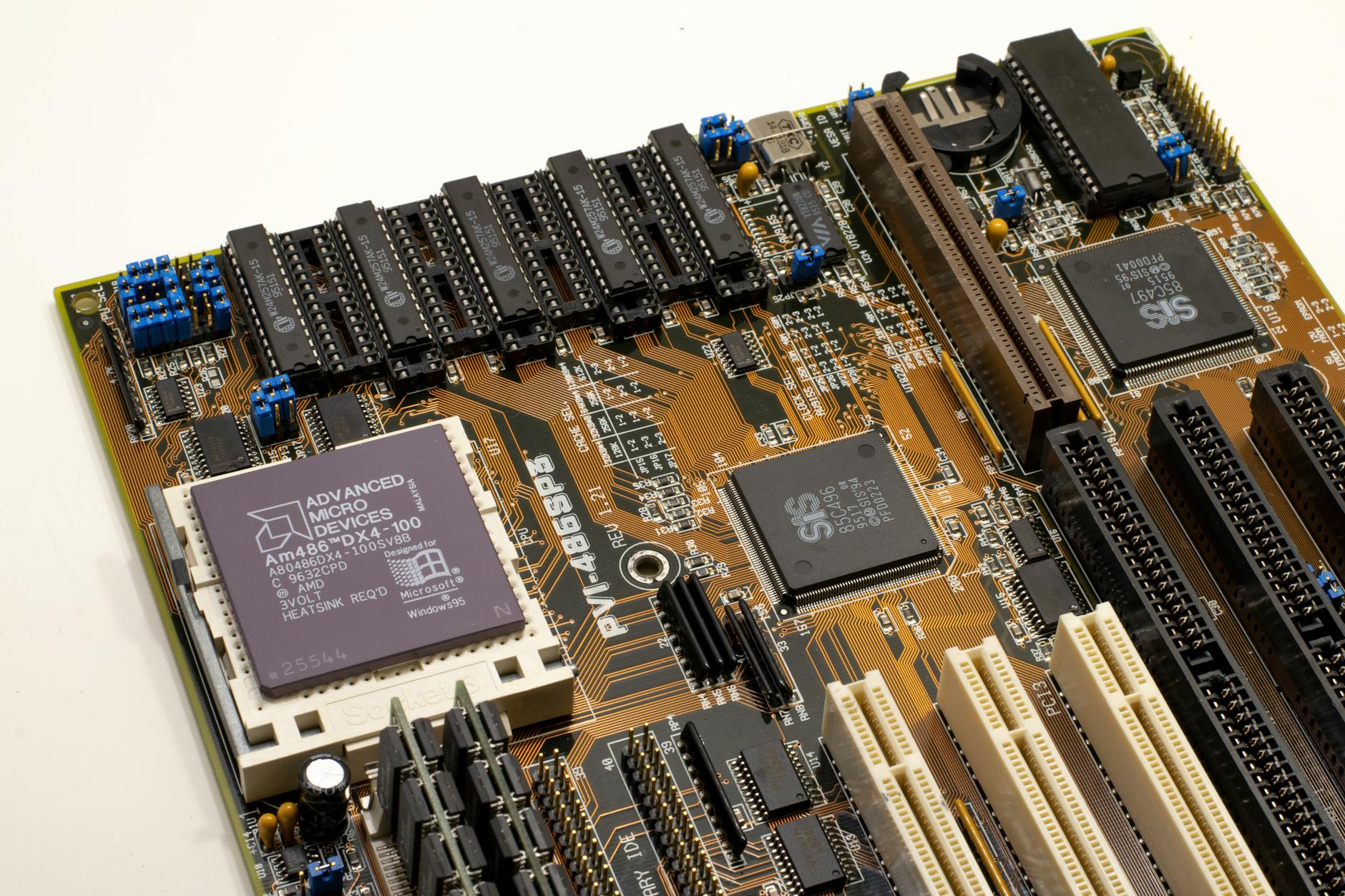

x86 to architektura typu CISC, bardzo upraszczając: bogaty, ciężki zestaw instrukcji, który przez lata puchł, bo trzeba było zachować kompatybilność ze starym oprogramowaniem i dodawać nowe możliwości (multimedia, szyfrowanie, wektory SIMD). Współczesny procesor x86 w środku i tak rozbija te złożone instrukcje na mniejsze mikro‑operacje, ale logika potrzebna do dekodowania jest skomplikowana i energochłonna.

ARM to RISC: instrukcje są prostsze, bardziej jednorodne, łatwiej przewidywalne dla procesora. Efekt: rdzeń ARM może być łatwiej projektowany pod kątem niskiego poboru energii i skalowalności. Producenci mogą licencjonować samą architekturę (ARM ISA) albo gotowe projekty rdzeni od firmy Arm Ltd., a potem dorabiać własne układy (SoC) pod konkretny rynek – od zegarka po serwer.

Do tego dochodzi model licencyjny. Intel i AMD kontrolują własne implementacje x86 – inni praktycznie zniknęli. ARM jest „franszyzą”: Qualcomm, Apple, MediaTek, Samsung i dziesiątki innych mogą tworzyć własne warianty. To uruchamia konkurencję i szybciej pcha do przodu pomysły typu: dedykowane akceleratory AI, rozbudowane bloki multimedialne, customowe kontrolery pamięci.

Dlaczego ARM latami siedział w smartfonach, a laptopy brał x86

Przez długi czas ARM w klasycznych komputerach nie miał większego sensu. Powód był prosty: ekosystem. Na x86 były:

- Windows z pełnym wsparciem sterowników, gier, aplikacji biznesowych,

- cała historia oprogramowania PC – od Office’a po niszowe programy do sterowania CNC,

- potężne narzędzia deweloperskie i kompilatory optymalizowane pod x86.

ARM w tym czasie rozwijał się w telefonach, gdzie priorytetem była bateria, integracja modemu, niska cena i mała ilość ciepła do odprowadzenia. Nikt nie oczekiwał, że smartfon zastąpi stację roboczą do CAD albo maszynę do montażu wideo. Próby wejścia ARM do laptopów – jak pierwsze konstrukcje z Windows RT czy pierwsze Surface’y na ARM – kończyły się słabo, bo brakowało kompatybilności, a wydajność była zbyt niska, by sensownie emulować x86.

Rynek laptopów był więc naturalnym terytorium x86. Producenci kładli nacisk na większą moc, a niekoniecznie na maksymalną oszczędność energii. Intel i AMD wyciskali kolejne procenty wydajności z procesu litograficznego, dodawali kolejne instrukcje, a świat PC akceptował krótszą baterię w zamian za „pełnoprawny komputer”.

Co zmieniły Apple Silicon i nowe układy Qualcomma

Przełom nastąpił, gdy ARM przestał kojarzyć się wyłącznie z „telefonicznym” poziomem mocy. Apple jako pierwsze pokazało, że można zbudować procesor ARM, który:

- ma wydajność zbliżoną lub wyższą od mobilnych procesorów x86 w wielu zadaniach,

- zużywa przy tym mniej energii, oferując bardzo długi czas pracy na baterii,

- jest zintegrowany z pamięcią, grafiką i akceleratorami w jednym, spójnym SoC.

Układy M1, potem M2 i M3 w MacBookach udowodniły, że „ARM = słaby, ale energooszczędny” to mit, jeśli włoży się sporo pracy w projekt. Kluczowe było połączenie: mocne rdzenie wysokiej wydajności, bardzo efektywne rdzenie energooszczędne, szybka pamięć współdzielona (Unified Memory) i dopracowane chłodzenie.

Na drugim froncie pojawił się Qualcomm ze Snapdragon X Elite i X Plus, a także kolejne generacje układów MediaTeku zapowiadanych do laptopów. Wersje „PC‑towe” ARM dostały wyższe limity mocy, większą liczbę rdzeni i mechanizmy przyspieszania AI. Microsoft zaczął agresywnie promować Windows on ARM jako równorzędną platformę, a nie ciekawostkę.

Połączenie: sukcesu Apple, rozwoju mobilnych SoC i kryzysu energetycznego (rosnące ceny prądu, presja na efektywność) sprawiło, że nagle ARM w laptopach zaczął wyglądać poważnie. Producenci mają tu jasny interes: niższe zużycie energii = cieńsze obudowy, mniej hałaśliwe chłodzenie, rzadziej wymieniane baterie, a przy okazji możliwość wyróżnienia się marketingowo.

Interesy wielkich graczy: Apple, Microsoft, Qualcomm, Intel, AMD

Za techniczną debatą ARM vs x86 stoją bardzo konkretne biznesy:

- Apple – przejście na Apple Silicon oznacza pełną kontrolę nad stosem: od krzemu, przez system, po kluczowe aplikacje. Mniej zależności od Intela, lepsza marża, trudniejsze odchodzenie klientów, bo aplikacje i workflow są mocno związane z ich platformą.

- Microsoft – chce mieć Windowsa działającego dobrze na różnych architekturach. ARM to dla nich sposób na lżejsze, always‑on urządzenia z dobrym LTE/5G, a także karta przetargowa w negocjacjach z Intelem i AMD. Im więcej sprzętu z Windows on ARM, tym mniejsza monopolistyczna siła x86.

- Qualcomm – szuka nowego dużego rynku poza smartfonami. Laptopy i lekkie komputery to naturalne rozszerzenie ich kompetencji: modemy, układy SoC, integracja wszystkiego w jednym czipie.

- Intel i AMD – bronią nie tylko technologii, ale i modelu biznesowego opartego na x86. Jednocześnie próbują gonić ARM w efektywności energetycznej i rozwijają własne pomysły na hybrydowe rdzenie, integrację i akceleratory AI.

Narracja „ARM to przyszłość” jest więc mocno napędzana interesami firm, które na tej zmianie zyskują. Z drugiej strony Intel i AMD nie mogą jej ignorować, bo zbyt powolna reakcja grozi utratą najbardziej dochodowych segmentów mobilnych.

Kiedy hasło „ARM to przyszłość wszystkiego” się rozpada

Stwierdzenie „ARM zastąpi x86 wszędzie” brzmi efektownie, ale nie wytrzymuje zderzenia z realiami. Są obszary, gdzie x86 jest wciąż bardzo trudno ruszyć:

- duże środowiska korporacyjne z masą legacy software,

- stacje robocze do specyficznych zastosowań (CAD, EDA, symulacje inżynierskie),

- gaming PC, gdzie liczy się nie tylko moc, ale i kompatybilność ze sterownikami, peryferiami, modami, antycheatami.

ARM ma rosnącą rolę w laptopach, lekkich desktopach, serwerach chmurowych i urządzeniach specjalizowanych, ale nie jest magicznym rozwiązaniem „do wszystkiego”. Są przypadki, w których przejście na ARM wprowadzi więcej problemów niż korzyści – zwłaszcza tam, gdzie kluczowe są bardzo konkretne aplikacje, integracje z urządzeniami czy plug‑iny, których nikt nie portuje.

Architektura ARM vs x86 bez marketingu – gdzie są prawdziwe różnice

Instrukcje, dekodowanie i mikro‑operacje – co z tego masz jako użytkownik

Procesor nie rozumie „Excela” czy „Photoshopa”. Dla niego wszystko sprowadza się do ciągu instrukcji. W x86 ten zestaw jest ogromny i historycznie narastał warstwa po warstwie. Współczesne CPU x86 (Intel Core, AMD Ryzen) muszą:

- odczytać z pamięci złożoną instrukcję,

- rozbić ją na mniejsze mikro‑operacje, które są wykonywane wewnętrznie,

- zadbać, by wszystkie wyjątki, tryby i „dziwactwa” zachowywały się tak samo, jak 10–20 lat temu.

To przekłada się na sporą część krzemu poświęconą na logikę dekodowania, bufory, cache instrukcji. Taki design ułatwia utrzymanie kompatybilności wstecznej, ale komplikuje optymalizację pod kątem niskiej mocy.

ARM ma prostszy i bardziej regularny zestaw instrukcji. Mniej „magicznych” rozkazów, więcej powtarzalnych klocków. Dekoder może być lżejszy, a planowanie mikro‑operacji przewidywalniejsze. W efekcie łatwiej osiągnąć przyzwoitą wydajność przy niższym napięciu i z mniejszym zużyciem energii. To widać szczególnie w scenariuszach: czuwanie, lekkie zadania, praca na baterii.

Skalowalność energetyczna ARMa i balast zgodności x86

Architektura ARM jest zaprojektowana tak, by dało się ją łatwo skalować. Ten sam repertuar instrukcji można użyć w:

- małym, jednordzeniowym układzie do IoT,

- środkowym SoC dla smartfonów,

- potężnym układzie serwerowym z kilkudziesięcioma rdzeniami.

Producenci dobierają liczby rdzeni, rozmiar cache, taktowanie i napięcia do konkretnego segmentu. Logika zarządzania energią może agresywnie usypiać rdzenie, sekcje cache, a nawet całe bloki funkcjonalne, gdy nie są używane.

x86 ma w teorii też możliwości oszczędzania energii, ale musi wlec za sobą kompatybilność z kodem, który powstał jeszcze w czasach, gdy energooszczędność nie była priorytetem. Dodatkowo, rozbudowany dekoder i logika legacy utrudniają zejście z poborem mocy tak nisko, jak w typowych mobilnych ARMach przy lekkich obciążeniach. Intel i AMD nadrabiają to zaawansowanymi stanami C/P, hybrydowymi rdzeniami i nowymi trybami zarządzania energią, ale punkt wyjściowy jest inny.

Strategie projektowe: „siłowe” GHz kontra inteligentne usypianie

Przez lata x86 szedł w kierunku wyższych częstotliwości, szerszych potoków, większej liczby jednostek wykonawczych i coraz bardziej agresywnego turbo. To podejście można określić jako „siłowe”: dużo krzemu, sporo mocy, ale za to ogromna wydajność jednowątkowa, która świetnie służy grom i aplikacjom ciężko zależnym od pojedynczego wątku.

ARM w mobile skupił się na czymś innym: jak zrobić, by telefon leżał w kieszeni i prawie nic nie zużywał, a gdy użytkownik chwyta go do ręki, aplikacje wstają natychmiast. Stąd koncept big.LITTLE, później rozwinięty do bardziej złożonych konfiguracji: kilka szybkich rdzeni do ciężkich zadań i wiele małych, ultraoszczędnych rdzeni do tła i drobnicy.

W laptopach na ARM tę filozofię przeniesiono niemal wprost. Procesor może np. używać jednego bardzo efektywnego rdzenia do podtrzymywania wideokonferencji, maila i kilku kart przeglądarki przy minimalnym zużyciu energii, a dopiero przy renderze wideo odpalić pełnię mocy wszystkich rdzeni.

x86 z kolei zaczął zapożyczać te pomysły (Intel: P‑Cores i E‑Cores, AMD: hybrydowe konstrukcje w drodze), ale stoi przed wyzwaniem: jak zachować kompatybilność i przewidywalność wydajności, gdy scheduler systemowy musi mądrze rozdawać zadania między bardzo różne typy rdzeni.

Gdzie x86 nadal ma przewagę: legacy, SIMD, dojrzałe narzędzia

Mimo wszystkich zalet ARM, x86 nie stoi jeszcze pod ścianą. Są obszary, gdzie ma bardzo mocne atuty:

- Kompatybilność legacy – cały ekosystem narzędzi, sterowników, bibliotek i frameworków oprogramowania przez dekady optymalizowano pod x86. Wiele z nich używa niskopoziomowych trików, które na ARM nie zadziałają lub działają gorzej przez emulację.

- Rozbudowane instrukcje SIMD – AVX, AVX2, AVX‑512 (choć nie wszędzie dostępne) umożliwiają bardzo szybkie przetwarzanie danych wektorowych. Dla kodu intensywnie korzystającego z tych rozszerzeń x86 potrafi nadal błyszczeć.

- Dojrzałe kompilatory i biblioteki – narzędzia typu ICC, LLVM/Clang, MSVC i biblioteki matematyczne są bardzo silnie dopracowane pod x86; ARM dogania, ale ma krótszą historię w desktopowo‑serwerowym świecie.

Efekt jest taki, że w niektórych profesjonalnych zastosowaniach – np. w specyficznych symulacjach, narzędziach EDA, mocno wyspecjalizowanych aplikacjach finansowych – x86 wciąż będzie wyborem bezpieczniejszym i często szybszym, przynajmniej do czasu, aż autorzy oprogramowania zainwestują poważne środki w pełne porty na ARM.

Kiedy sama „architektura” jest przeceniana

Debata ARM vs x86 często sprowadza się do pojedynku architektur, podczas gdy o realnym doświadczeniu użytkownika decyduje cała platforma:

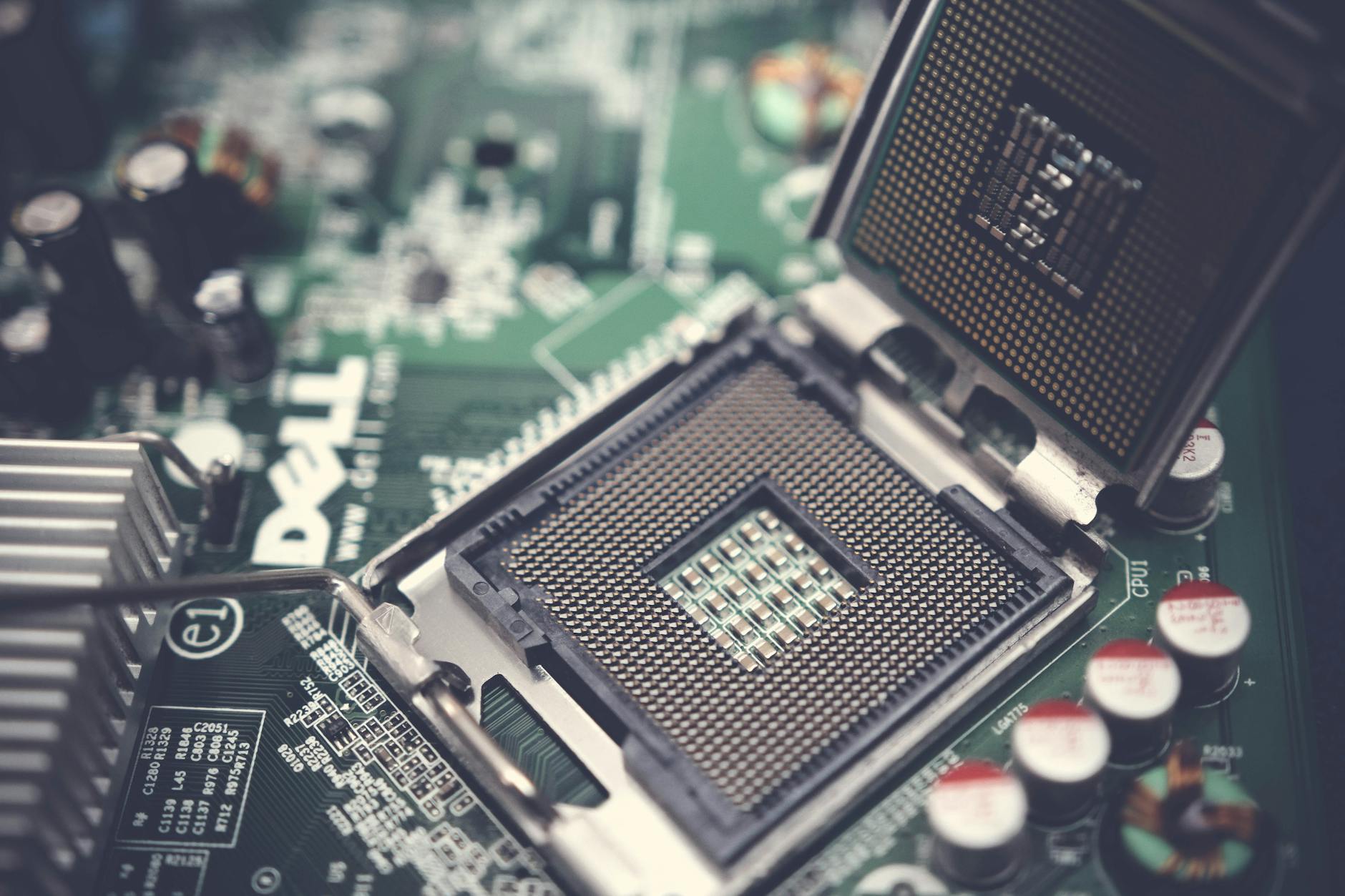

- jakość i ilość pamięci (przepustowość, opóźnienia, pojemność),

- wydajność i stabilność systemu chłodzenia,

- szybkość SSD i kontrolera NVMe,

- jakość sterowników, firmware i BIOS/UEFI,

- system operacyjny i jego scheduler zadań.

„Magia” platformy: SoC, pamięć i reszta układu

ARM zwykle nie występuje solo. W laptopach to niemal zawsze SoC – jeden układ z CPU, GPU, NPU (akcelerator AI), kontrolerami pamięci, modemem, kodekami wideo. To podejście z telefonów, przeniesione do świata PC. Daje sporą przewagę: mniejsza liczba osobnych czipów, mniej skoków sygnału, lepsza kontrola nad zasilaniem całej platformy.

W x86 przez lata wyglądało to inaczej: CPU + chipset, często osobny kontroler Thunderbolt, osobne kontrolery do innych funkcji. Integracja rośnie (zwłaszcza w mobilnych układach Intela i AMD), ale ARM startuje z pozycji „wszystko w jednej paczce”. Stąd bierze się nie tylko efektywność energetyczna, ale też możliwość ciasnego spięcia systemu z hardware’em – dokładnie to robi Apple, ale coraz więcej producentów z Windows on ARM próbuje naśladować ten model.

Cena jest oczywista: mniejsza modularność. Jeśli w laptopie ARM masz wlutowaną pamięć i mocno zintegrowany SoC, szanse na rozbudowę RAM czy naprawę poza autoryzowanym serwisem spadają. „Eleganckie” rozwiązanie techniczne niekoniecznie jest więc bardziej przyjazne użytkownikowi i serwisantom.

ARM w praktyce mobilnej – jak naprawdę wygląda wydajność

Benchmarki kontra codzienność

Wykresy z Geekbencha czy Cinebencha wyglądają spektakularnie i lubią je zarówno marketingowcy, jak i fani forumowych dyskusji. Problem w tym, że syntetyczny test mierzy konkretny fragment rzeczywistości. Z punktu widzenia użytkownika liczy się coś innego:

- jak szybko startuje system i aplikacje,

- czy przy kilkunastu kartach w przeglądarce i wideokonferencji komputer nie dławi się i nie nagrzewa jak piecyk,

- czy laptop po 2–3 godzinach pracy na baterii nie zaczyna brutalnie obcinać wydajności.

Laptopy z ARM zwykle wypadają świetnie w dwóch pierwszych punktach, jeśli aplikacje mają natywną wersję. Start systemu bywa błyskawiczny, przejście ze stanu uśpienia – praktycznie natychmiastowe, przeglądarka i komunikatory działają płynnie. Problem zaczyna się, gdy:

- w grę wchodzi emulacja x86,

- używasz programów ciężko obciążających CPU / GPU, a nieprzystosowanych do ARM,

- zależy ci na przewidywalnej wydajności przy długotrwałym obciążeniu (np. kompilacje, render).

Single‑thread vs multi‑thread: gdzie ARM błyszczy, a gdzie przegrywa

Popularna narracja: „ARM ma mniejsze taktowanie, więc musi być wolniejszy”. To zwykle nieprawda. W nowoczesnych układach ARM wydajność na cykl (IPC) potrafi być bardzo wysoka, więc rdzeń na niższym zegarze potrafi dogonić, a czasem przegonić rdzeń x86.

W lekkich, jednowątkowych zadaniach (UI, proste operacje na dokumentach, obsługa skrótów, logika aplikacji) nowoczesne rdzenie ARM z segmentu laptopowego potrafią działać bardzo responsywnie przy niższym poborze mocy. To idealny scenariusz dla typowego użytkownika, który żyje w przeglądarce, Office i komunikatorach.

Z kolei w zadaniach mocno równoległych pojawia się inna dynamika. x86, przy liberalnym limicie mocy i dobrym chłodzeniu, wciąż bywa królem „siłowego” multi‑threadingu: kompilacje dużych projektów, render wideo, obróbka 3D – tam dużym, rozgrzanym układom x86 jest łatwiej oddać pełną moc bez oglądania się na kilka godzin pracy na baterii. ARM może mieć wiele rdzeni, ale producenci laptopów często projektują platformę z myślą o ciszy i czasie pracy, nie o utrzymaniu maksymalnego TDP non stop.

Thermal throttling, czyli fizyki nie da się oszukać

ARM kojarzy się z chłodnym, pasywnie chłodzonym sprzętem. Do pewnego stopnia słusznie, ale tylko przy konkretnym profilu użycia. W cienkim laptopie ARM, jeśli odpalisz wielogodzinny render lub wirtualki, w końcu też trafisz na ścianę termiczną. Różnica polega na tym, że:

- ARM częściej projektuje się tak, by nie wychodził daleko ponad swoje „komfortowe” TDP – więc spadki wydajności są mniejsze, ale szczytowa wydajność również bywa niższa niż w mocno dociśniętym x86,

- x86 potrafi początkowo osiągnąć bardzo wysokie turbo, a dopiero po chwili zejść do poziomu, który da się realnie utrzymać w danej obudowie.

To rodzi prostą konsekwencję: porównując laptopy ARM i x86, sens ma test długotrwałego obciążenia w realnym profilu pracy, a nie 30‑sekundowy sprint. Dla kogoś, kto raz na tydzień wyrenderuje krótkie wideo, a na co dzień pisze i siedzi w Teamsach, ARM może być wygodniejszy. Dla programisty odpalającego kilka wirtualnych mas i Dockerów non stop – już niekoniecznie.

Emulacja x86 na ARM: techniczne cudo czy konieczne zło

Jak faktycznie działa emulacja

Emulacja x86 na ARM nie polega na „przekompilowaniu w locie wszystkiego”. Mechanizmy różnią się między platformami (Apple, Microsoft, inni), ale ogólny schemat jest podobny:

- instrukcje x86 są odczytywane blokami,

- tłumacz (JIT) przekłada je na sekwencje instrukcji ARM,

- powstały kod ARM jest cache’owany, by przy kolejnym wywołaniu można było pominąć tłumaczenie.

Technicznie to imponujące – szczególnie, gdy emulowane aplikacje potrafią działać szybciej niż stare laptopy z natywnym x86. Ale „cudo” ma swoje limity: tłumaczenie nigdy nie będzie darmowe, dostęp do specyficznych instrukcji lub sterowników bywa problematyczny, a aplikacje korzystające z własnych tricków JIT (np. niektóre silniki gier) mogą cierpieć bardziej niż prosty Word.

Scenariusze, w których emulacja „wystarcza”

Emulacja nie zawsze jest wrogiem. Są scenariusze, w których działa wystarczająco dobrze, by użytkownik był zadowolony:

- starsze aplikacje biurowe, które zostały porzucone przez producenta,

- rzadko używane narzędzia, do których nie opłaca się pisać natywnej wersji,

- lekkie programy narzędziowe, które nie katują CPU i GPU.

Przykładowo: stary program do faktur, od którego zależy mała firma, ale który wykonuje proste operacje na bazie danych – w emulacji jest duża szansa na akceptowalną wydajność. Tylko że to sytuacja „ratunkowa”. Budowanie całego głównego workflow na emulacji to już zupełnie inna historia.

Kiedy emulacja staje się kulą u nogi

Popularne zalecenie: „Jeśli aplikacja nie ma wersji ARM, użyj emulacji, będzie OK”. Bywa prawdziwe, ale tylko do pewnego pułapu złożoności. Problemy zaczynają się wtedy, gdy:

- aplikacja intensywnie używa instrukcji SIMD (AVX, SSE) – tłumaczenie na ARM często nie jest 1:1,

- w grę wchodzą sterowniki kernel‑mode lub rozszerzenia AV/antycheat – mogą nie działać wcale,

- potrzebujesz spójnej wydajności w długim czasie (np. rozwój oprogramowania, buildy, CI/CD).

Tu emulacja staje się „koniecznym złem” – rozwiązaniem przejściowym, a nie docelowym. Jeśli wiesz, że na danej maszynie spędzisz większość czasu w takich aplikacjach, lepiej przyjąć, że ARM nie jest jeszcze gotowy na twoje potrzeby, niż liczyć na cud optymalizacji.

Emulacja a bezpieczeństwo i stabilność

Trzeci, często pomijany aspekt to bezpieczeństwo i debugowanie. Gdy między aplikacją a sprzętem pojawia się dodatkowa warstwa tłumacząca instrukcje,:

- logi i zrzuty błędów potrafią wyglądać inaczej niż na x86,

- czasem trudniej odtworzyć incydent bezpieczeństwa 1:1 na maszynie testowej,

- oprogramowanie ochronne może mieć ograniczony wgląd w to, co faktycznie dzieje się „pod spodem”.

W środowiskach, gdzie ważna jest przewidywalność, zgodność z auditami i ścisła kontrola bezpieczeństwa, to może być argument przeciw masowemu wdrażaniu ARM z ciężkim użyciem emulacji, nawet jeśli wydajność na jednostkę użytkownika wygląda zachęcająco.

Kompatybilność oprogramowania – największa mina na drodze do ARM

Ekosystem aplikacji: nie tylko „czy działa”, ale „jak działa”

Pierwsza fala entuzjazmu wokół ARM w laptopach koncentruje się zwykle na tym, że „większość popularnych aplikacji już działa”. To jednak dopiero połowa obrazu. Rzeczywiste pytanie brzmi:

- czy działają natywnie, czy przez emulację,

- czy wszystkie funkcje są dostępne (w tym wtyczki, makra, integracje),

- czy wersja ARM ma takie same priorytety rozwojowe jak x86.

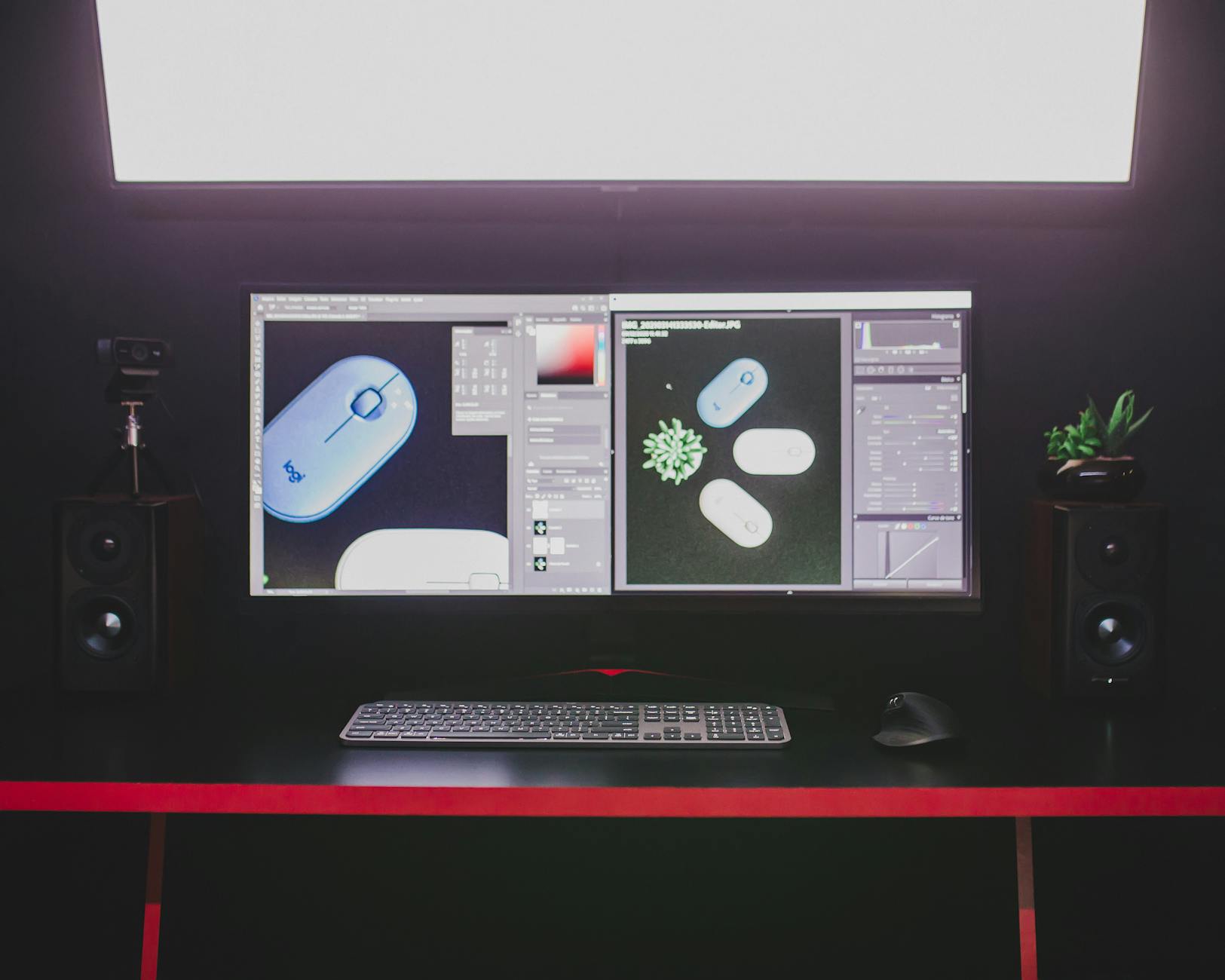

Dobrym testem jest nie sama aplikacja, ale cały workflow. Przykład: edytor wideo może mieć wersję ARM, ale jeśli ulubione wtyczki efektów nie działają lub wymagają emulacji, nagle okazuje się, że połowa oszczędności energii znika, a komfort pracy leci w dół.

Środowiska korporacyjne: integracje, które wszystko psują

W firmach problem zwykle nie leży w „braku Worda na ARM”, tylko w:

- niestandardowych dodatkach do pakietu biurowego,

- wewnętrznych aplikacjach pisanych lata temu,

- pluginach do systemów ERP/CRM, które ktoś stworzył raz i od dawna nie aktualizuje.

Te elementy są często na x86 sklejone z konkretną wersją systemu, pakietu runtime, biblioteką COM. Migracja ich na ARM bywa kosztowniejsza niż wszystkie potencjalne oszczędności na baterii. Dlatego w praktyce duże organizacje często eksperymentują z ARM w małych, wyizolowanych grupach użytkowników, zamiast robić wielką falę migracji.

Linux i ARM: raj dla entuzjastów, przeszkody dla reszty

Linux teoretycznie świetnie nadaje się do ARM – kernel ma wsparcie, wiele dystrybucji publikuje obrazy ARM, kompilatory tam działają od lat. Rzeczywistość laptopowa jest bardziej zniuansowana:

- część sprzętu ARM jest mocno zamknięta – brak otwartych sterowników do GPU, Wi‑Fi, modemów,

- UEFI/firmware bywają ograniczone, co utrudnia instalację alternatywnych systemów,

- niektóre dystrybucje na ARM traktowane są jako „best effort”, bez pełnej dokumentacji pod konkretny model.

Z punktu widzenia entuzjasty, który lubi dłubać i kompilować własne jądro, to atrakcyjny plac zabaw. Dla admina floty laptopów w firmie – poważne ryzyko. Paradoksalnie więc na ARM lepiej wspierany bywa zamknięty, ściśle kontrolowany stack (np. sprzęt + OS od jednego producenta), niż swobodne mieszanie componentów w stylu „instaluję co chcę, gdzie chcę”.

Gry, antycheat i DRM – najtwardszy orzech

Gaming na ARM to osobny temat i jednocześnie brutalny test kompatybilności. Nawet jeśli:

- silnik gry działa w emulacji lub ma wersję ARM,

- wydajność CPU/GPU jest wystarczająca,

- sterowniki graficzne dają radę,

na drodze stają antycheaty, systemy DRM i rozbudowane launchery. Te komponenty działają głęboko w systemie, często korzystają z niskopoziomowych mechanizmów, własnych driverów i mają bardzo konserwatywne podejście do „nietypowych” środowisk. Z ich perspektywy ARM + emulacja to proszenie się o problemy: trudniej odróżnić cheat od legalnej abstrakcji software’owej.

Dlatego nawet jeśli gry single‑player z prostym zabezpieczeniem ruszą na ARM bez większego dramatu, pełny gamingowy ekosystem (sieciowe FPS‑y, MMO, turniejowe tytuły) pozostanie długo silnie związany z x86. Dla producentów gier to dodatkowa matryca testów, a dla operatorów antycheatów – nowe wektory ataku do ogarnięcia.

Energooszczędność i bateria – czy ARM zawsze wygrywa z x86

ARM jako synonim oszczędności – kiedy działa, a kiedy nie

Uproszczone hasło brzmi: „ARM = dobra bateria, x86 = zły”. Przy lekkim, przerywanym użyciu zwykle jest w tym sporo prawdy. W scenariuszu „mail + przeglądarka + komunikator + okazjonalny dokument” laptopy ARM:

- dłużej trzymają w stanie czuwania,

- szybciej wstają po zamknięciu pokrywy,

- często dłużej działają przy ekranie o tej samej jasności.

Jednak w momencie, gdy laptop staje się mobilną stacją roboczą, różnica potrafi się spłaszczyć. Jeśli przez kilka godzin ciśniesz CPU/GPU na 80–100% mocy, głównym wrogiem staje się pojemność baterii i możliwości chłodzenia, a nie to, czy instrukcje dekoduje ARM, czy x86. Wtedy dobrze zaprojektowany laptop x86 może zaoferować bardzo podobny czas pracy, tyle że przy nieco wyższym TDP i być może głośniejszym chłodzeniu.

Always‑on i connected standby – ukryta przewaga ARM

Pełna mobilność vs „przenośne biurko”

ARM błyszczy tam, gdzie laptop faktycznie bywa mobilny. Jeśli sprzęt codziennie ląduje w plecaku, jeździ między salami, pracuje w pociągu i na lotnisku, różnice w zachowaniu przy niskich obciążeniach kumulują się w realne godziny pracy więcej. W trybie „otwieram na chwilę, odpisuję, zamykam” architektura z mocnym naciskiem na idle‑power i przycinanie bloków wykonawczych ma przewagę nad klasycznym x86, które historycznie optymalizowano pod długi, ciągły load.

Problem zaczyna się wtedy, gdy laptop trafia na biurko, do stacji dokującej i 90% czasu spędza podłączony do zasilania. Popularna rada: „weź ARM, będziesz mieć super baterię” przestaje mieć sens, jeśli typowy dzień użytkownika to 8 godzin przy dwóch monitorach, kompilacje, spotkania w Teamsie i zero wyjść w teren. W takim scenariuszu dodatkowa efektywność energetyczna jest mniej odczuwalna niż:

- stabilność sterowników pod wieloma monitorami i stacjami dokującymi,

- dostępność narzędzi i akceleracji (np. maszyny wirtualne, debugery),

- dojrzałość ekosystemu pod intensywne I/O (VM, Docker, bazy lokalne).

Jeśli więc laptop ma być głównie „przenośnym desktopem”, przewaga ARM w baterii bywa czysto teoretyczna. Wtedy lepiej dobrać x86 z sensownym chłodzeniem i mocniejszym GPU, zamiast gonić za dodatkowymi dwoma godzinami SOT‑u, których i tak się nie wykorzysta.

ARM a termika – chłodniej nie znaczy zawsze ciszej

Często powtarza się, że laptopy ARM są chłodniejsze i cichsze. W lekkiej pracy – tak, bo rzadziej odpalają wentylatory na wysokie obroty, a niższe TDP pozwala schodzić z zegarami bez dramatycznego spadku responsywności. Gdy jednak wjeżdżają długie obciążenia, projekt chłodzenia liczy się tak samo jak w x86. Oszczędniejszy SoC nie naprawi zbyt cienkich heatpipe’ów, agresywnej krzywej wentylatora czy obudowy z jednym wylotem powietrza.

Przy ARM‑owych konstrukcjach pojawia się inny efekt uboczny: producenci chętniej „odchudzają” układ chłodzenia, korzystając z tego, że CPU nominalnie zużywa mniej. W efekcie przy krótkich burstach laptop jest przyjemnie chłodny, ale przy dłuższym stresie szybciej dobija do limitów termicznych i trzyma niższe taktowania niż równie cienki, ale lepiej schłodzony model x86. Słychać to też w wentylatorach – czasem krótsza, ale intensywniejsza „susznia” bywa bardziej irytująca niż stały, umiarkowany szum.

ARM w trybie „offloadu” – kiedy lokalna moc przestaje być kluczowa

Coraz częściej ciężkie obliczenia lądują nie na laptopie, tylko w chmurze: render, trenowanie modelu ML, CI/CD, analityka – wszystko to można odsunąć od maszyny użytkownika. W takim modelu laptop staje się głównie klientem do RDP/SSH/VS Code Remote, a jego najważniejszymi cechami stają się:

- dobra klawiatura i ekran,

- stabilne Wi‑Fi/5G z niskim poborem mocy,

- czas pracy przy wielu lekkich procesach (VPN, klient Git, komunikatory).

Tu ARM wypada bardzo sensownie. Jeśli twoje builds i testy i tak lecą na serwerach, a lokalnie robisz tylko edycję kodu i szybkie uruchomienia, realna potrzeba posiadania wielordzeniowego x86 znika. Warunek: infrastruktura zdalna musi być już „ogarnięta”, a zespół musi akceptować, że część debugowania odbywa się na odległym środowisku, a nie na lokalnej maszynie z pełnym dostępem do sprzętu.

ARM w laptopach dla deweloperów – scenariusze, które działają i które bolą

Dla programistów ARM brzmi dziś trochę jak deja vu z czasów pierwszych ultrabooków: lekkie, fajne, ale z gwiazdkami. Są jednak profile, dla których ma to już techniczny sens:

- backend/cloud – jeśli środowisko docelowe to Linux/ARM (np. niektóre instancje chmurowe, edge), natywny laptop ARM pozwala lepiej odwzorować produkcję. Docker, K8s, narzędzia CLI mają coraz lepsze wsparcie, a brak warstwy emulacji upraszcza debugging.

- web + lekkie usługi – Node, Python, Go, Rust kompilują się sprawnie, a przeniesienie testów E2E i buildów na CI zmniejsza znaczenie surowej mocy lokalnego CPU.

- aplikacje natywne pod ARM (mobile, IoT) – kompilacja na tę samą architekturę, na której będzie działał target, eliminuje klasę subtelnych błędów związanych z ABI i alignmentem.

Po drugiej stronie są scenariusze, które wciąż są bardziej bolesne niż na x86:

- tworzenie gier i aplikacji z ciężkim toolchainem (UE, Unity, Visual Studio + tysiąc pluginów),

- legacy .NET, stare biblioteki C/C++ z zamkniętym kodem, które nie mają buildów na ARM,

- narzędzia wymagające wirtualizacji x86 (starsze środowiska testowe, appliance’y, routery virtualne).

Tu każda próba „jakoś to zadziała na ARM” kończy się zwykle kombinacją emulacji, zdalnych VM‑ek i obejść, która zjada wszystkie oszczędności czasu i prądu.

Kiedy ARM w laptopie ma dziś najwięcej sensu

Naturalny odruch to szukanie jednego, uniwersalnego werdyktu. Bardziej użyteczna jest jednak lista konfiguracji, w których ARM w laptopie faktycznie ma przewagę nad x86 w obecnym ekosystemie. Najczęściej są to sytuacje, gdy spełnione są jednocześnie trzy warunki:

- główne aplikacje są natywne (lub mają pełnowartościowe porty ARM, bez brakujących pluginów),

- dominujące obciążenie to lekka, przerywana praca z przewagą czasu w idle i krótkimi burstami,

- ważniejsza jest mobilność niż maksymalna moc – dużo podróży, praca na baterii, brak stałego biurka.

Dobry przykład to konsultant lub architekt IT, który większość dnia spędza w przeglądarce, na callach wideo, w dokumentach, sporadycznie robiąc SSH na serwery czy szybkie skrypty. Taka osoba realnie wykorzysta lżejszą konstrukcję, lepszy standby i dłuższą pracę na baterii. W przypadku inżyniera DevOps, który kilka razy dziennie odpala ciężkie pipeline’y lokalnie i robi debugging low‑level, ta kalkulacja wygląda zupełnie inaczej.

Typowe mity wokół ARM w laptopach

Wokół ARM narosło kilka prostych sloganów, które dobrze brzmią, ale w praktyce potrafią wprowadzić w błąd. Warto je osadzić w konkretnych kontekstach zamiast traktować jak uniwersalne prawdy.

- „ARM jest zawsze bardziej energooszczędny” – prawdziwe głównie przy lekkiej, przerywanej pracy i dobrej optymalizacji OS. Przy długotrwałych 100% CPU/GPU liczy się przede wszystkim sprawność konkretnej implementacji i chłodzenie, a różnice między klasowym x86 i ARM potrafią być mniejsze niż sugeruje marketing.

- „Emulacja rozwiązuje problem kompatybilności” – rozwiązuje go dla prostych aplikacji, ale nie dla całych ekosystemów opartych o sterowniki, rozszerzenia security, antycheat czy enterprise’owe pluginy. Im bardziej „przyspawany” do platformy jest dany soft, tym gorzej znosi dodatkową warstwę tłumaczącą.

- „ARM jest jeszcze za słaby dla profesjonalistów” – prawdziwe dla części zastosowań (ciężkie IDE, gry, CAD), ale fałszywe dla rosnącej grupy zawodów, gdzie większość mocy obliczeniowej przeniosła się do chmury, a laptop jest głównie terminalem z lokalnym buforem.

Dobór architektury przestaje być pytaniem „co jest obiektywnie lepsze”, a staje się pytaniem „kto i jak będzie używał tego konkretnego laptopa przez najbliższe lata”. Tylko w takim ujęciu decyzja ARM vs x86 zaczyna mieć techniczny sens, zamiast sprowadzać się do ścigania się z tabelkami w materiałach marketingowych.

Najczęściej zadawane pytania (FAQ)

Czym różni się ARM od x86 w praktyce dla użytkownika laptopa?

Dla użytkownika kluczowe są trzy rzeczy: czas pracy na baterii, kultura pracy (temperatury, hałas) i kompatybilność programów. Laptopy z ARM zwykle wygrywają w dwóch pierwszych kategoriach – przy podobnej wydajności potrafią działać dłużej na baterii i mniej się grzeją, bo sam rdzeń jest prostszy i zaprojektowany z myślą o efektywności energetycznej.

Z kolei x86 nadal ma mocniejszy ekosystem oprogramowania, zwłaszcza przy grach, zaawansowanych aplikacjach inżynierskich czy niszowych narzędziach. Różnica w „odczuwalnej mocy” w biurze, przeglądarce czy pracy z dokumentami jest często mniejsza, niż się wydaje, ale na x86 rzadziej natkniesz się na problemy z kompatybilnością.

Czy laptop z ARM nadaje się do gier?

Na dziś ARM w laptopach do gier to wciąż kompromis. Lekkie, webowe i prostsze tytuły 2D czy gry z Microsoft Store zwykle działają dobrze, a coraz więcej produkcji będzie mieć natywne wersje ARM lub wspierać emulację. Problem zaczyna się przy dużych grach AAA z rozbudowanymi zabezpieczeniami, antycheatami, sterownikami i launcherami – tu x86 ma przewagę.

Popularna rada „ARM jest super, bo bateria trzyma, więc bierz do wszystkiego” przestaje działać właśnie przy gamingu. Jeśli głównym zastosowaniem jest granie w nowe, wymagające tytuły z maksymalną kompatybilnością z peryferiami (VR, joysticki, niestandardowe kontrolery), bezpieczniej wybrać x86. ARM w grach ma sens raczej przy okazjonalnym, mniej wymagającym graniu.

Czy warto kupić laptopa z ARM do pracy biurowej i zdalnej?

Do typowej pracy biurowej (Office, Teams, Zoom, przeglądarka z wieloma kartami, poczta, komunikatory) laptopy ARM zaczynają mieć bardzo dużo sensu. Oferują długi czas pracy na baterii, często mają wbudowany modem LTE/5G i działają bardziej jak „duży smartfon”: wybudzają się natychmiast, są zawsze online i mniej się grzeją na kolanach.

Pułapka pojawia się, gdy w pracy wykorzystujesz jeden konkretny, starszy program Windowsowy, na którym „stoi” cały proces biznesowy albo kluczowy plugin do Excela, który nigdy nie był aktualizowany. Tego typu oprogramowanie może się na ARM uruchamiać gorzej lub wcale. W takiej sytuacji lepiej najpierw przetestować je na Windows on ARM lub pozostać przy x86.

Czy ARM faktycznie zużywa mniej energii niż x86?

Architektura ARM sprzyja niższemu zużyciu energii: prostszy dekoder instrukcji, bardziej regularne operacje i możliwość dostosowania całego układu SoC pod konkretne zastosowanie (np. laptop, tablet, serwer). To pozwala producentom projektować układy, które przy tej samej pracy wykonują mniej „zbędnej” roboty w tle.

Nie oznacza to jednak, że każdy ARM z definicji będzie bardziej oszczędny niż każdy x86. Wysokowydajny ARM w laptopie z podniesionym limitem mocy i mocną grafiką może zużywać podobnie dużo energii co smukły ultrabook x86. Korzyść energetyczna jest największa tam, gdzie priorytetem są lekka obudowa, chłodna praca i długi czas na baterii, a nie maksymalne FPS-y czy wielowątkowy rendering.

Czy ARM zastąpi x86 w laptopach w najbliższych latach?

ARM w laptopach będzie rósł, ale „pełne zastąpienie” x86 jest mało realistycznym scenariuszem. ARM świetnie odnajduje się w ultramobilnych konstrukcjach, ultrabookach, lekkich stacjach roboczych i maszynach dla osób, które żyją głównie w przeglądarce i aplikacjach biurowych.

x86 długo utrzyma silną pozycję w laptopach dla graczy, mobilnych stacjach roboczych, sprzęcie dla firm z rozbudowanym legacy software i wszędzie tam, gdzie lista wymagań zaczyna się od „Musi działać dokładnie ten konkretny program i sprzęt”. Bardziej realny jest scenariusz trwałej koegzystencji niż „wyparcia” jednej architektury przez drugą.

Czy Windows na ARM jest już „dojrzały”, żeby na nim polegać?

Windows on ARM jest znacznie dojrzalszy niż przy pierwszych próbach (np. Windows RT). Coraz więcej aplikacji ma natywne wersje ARM, a emulacja x86 jest wystarczająca do sporej części biurowych i webowych zastosowań. Microsoft mocno inwestuje w tę platformę, zwłaszcza w kontekście AI i urządzeń always‑connected.

To nie znaczy, że można bezrefleksyjnie migrować wszystko. Środowiska z rozbudowaną infrastrukturą IT, specyficznymi sterownikami, wtyczkami do ERP czy systemami ochrony końcówek powinny traktować Windows on ARM jako nową platformę, wymagającą testów i pilotażu. Dla użytkownika domowego lub freelancera pracującego głównie w chmurze, ryzyko jest znacznie mniejsze niż kilka lat temu.